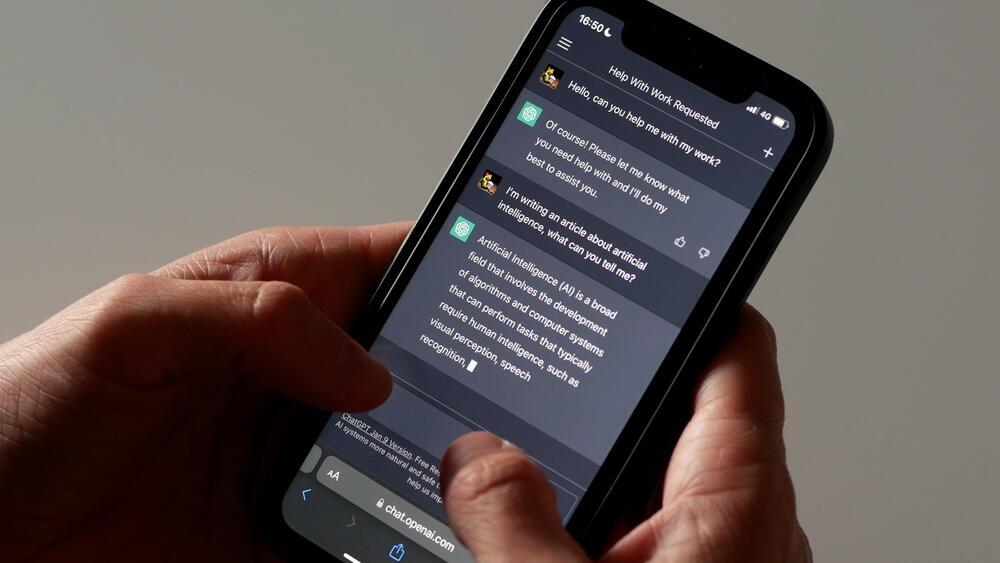

Пользователи ChatGPT были шокированы, обнаружив, что их интимные и личные беседы с чат-ботом OpenAI оказались в открытом доступе и были видны через простой поиск в Google. Компании, занимающиеся кибербезопасностью, не раз предупреждали об опасности передачи личной информации чат-ботам, однако, похоже, последний инцидент выявил тысячи случаев непреднамеренного распространения данных, что может затронуть многих пользователей. Об этом 5 августа пишет Ynet.

По сообщениям, OpenAI недавно запустила новую функцию, позволявшую делиться историей чатов в открытой сети. Хотя для активации этой функции требовалось явное согласие пользователей, ее описание оказалось слишком расплывчатым. Многие были потрясены, когда личная информация из их разговоров начала появляться в результатах поиска Google.

Функция под названием "Сделать чаты видимыми" была задумана для того, чтобы пользователи могли делиться ссылками на свои разговоры с друзьями, родственниками или коллегами, предполагая, что ссылки получат только те, кому они предназначены. Однако в примечаниях мелким шрифтом было указано, что включение этой опции позволяет чатам отображаться в поисковых системах — "нечто, что не совсем соответствовало ожиданиям пользователей", признали в компании.

Проверка, проведенная сайтом Fast Company, показала, что около 4500 чатов можно было найти, введя фрагменты ссылок для совместного доступа в поисковой строке Google. Многие из этих бесед содержали особо чувствительные и личные данные, которые никто не захотел бы публиковать в открытом доступе. Фактически утечка быстро превратилась в своеобразный "челлендж" для интернет-пользователей, которые начали выкладывать в X (Twitter) и Reddit разные "пикантные находки".

Хотя в результатах поиска не раскрывались полные данные пользователей, во многих разговорах присутствовали идентифицирующие детали: имена, местоположение и другая личная информация. Среди утекших данных оказались беседы на глубоко личные темы — тревожность, зависимость, насилие и другие чувствительные вопросы.

OpenAI быстро отключила функцию и описала ее как "краткосрочный эксперимент", целью которого было распространение "полезных" бесед. Сейчас компания работает над удалением из индекса Google и других поисковых систем всех материалов, опубликованных таким образом.

Инцидент вновь подчеркнул, насколько важно соблюдать максимальную осторожность при использовании чат-ботов на основе ИИ.

Напомним, что американский суд обязал OpenAI хранить все журналы чатов без ограничения по времени.

Гендиректор OpenAI Сэм Альтман признал, что переписки с ChatGPT не являются приватными. Обычно компания удаляла их время от времени, но из-за незавершенных судебных разбирательств (включая иск The New York Times, проверяющий, способен ли ChatGPT воспроизводить материалы, защищенные авторским правом) юридические команды могут просматривать все данные, введенные пользователями, до завершения дела.

Речь идет не только о частных разговорах, но и о возможной утечке коммерческих секретов. В 2023 году сотрудники Samsung были пойманы на том, что использовали ChatGPT таким образом, что непреднамеренно раскрыли конфиденциальную информацию компании для OpenAI. Например, просьбы к чат-боту оптимизировать код или сделать резюме встреч требовали ввода данных, которые могли содержать коммерческие тайны.